FUENTE:techxplore.com

AUTOR:Bernadette Young, Columbia University School of Engineering and Applied Science

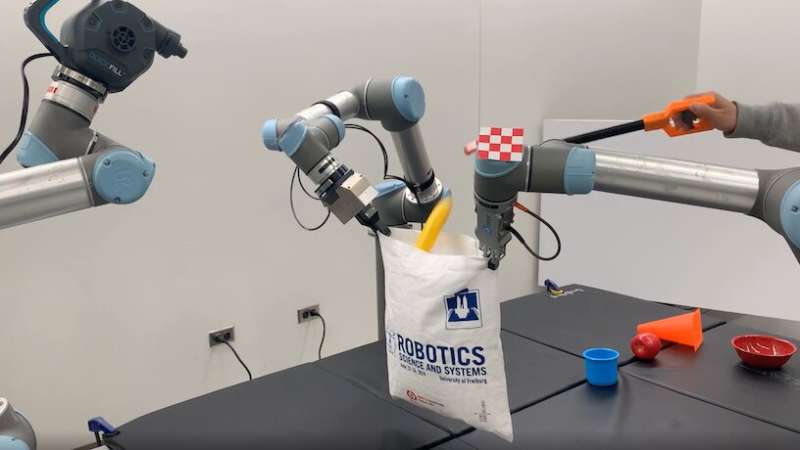

El marco de aprendizaje autosupervisado que Columbia Engineers denomina DextAIRity aprende a realizar eficazmente una tarea mediante una secuencia de agarres o soplado. A través de una retroalimentación visual, el sistema utiliza una formulación de bucle cerrado que ajusta continuamente su dirección de soplado. Crédito: Zhenjia Xu/Columbia Engineering

Los robots están por todas partes, desde drones que graban vídeos en el cielo hasta los que sirven comida en los restaurantes y desactivan bombas en situaciones de emergencia. De forma lenta, pero indudable, los robots están mejorando la calidad de la vida humana al aumentar nuestras capacidades, liberar tiempo e incrementar nuestra seguridad y bienestar personal. Aunque los robots actuales son cada vez más competentes en tareas sencillas, la gestión de solicitudes más complejas exigirá un mayor desarrollo tanto de la movilidad como de la inteligencia.

Los informáticos de Ingeniería de Columbia y del Instituto de Investigación de Toyota están profundizando en la psicología, la física y la geometría para crear algoritmos que permitan a los robots adaptarse a su entorno y aprender a hacer cosas de forma autónoma. Este trabajo es vital para que los robots puedan afrontar los nuevos retos derivados del envejecimiento de la sociedad y prestar un mejor apoyo, especialmente a las personas mayores y con discapacidad.

Enseñar a los robots la oclusión y permanencia de objetos

Un reto de larga data en el campo de la visión computarizada es la permanencia del objeto, un concepto bien conocido en psicología que implica entender que un objetivo siempre existe, aun cuando no es visible en un momento dado. Es fundamental que los robots comprendan nuestro mundo dinámico y cambiante. Pero la mayoría de instancias de este tipo ignoran por completo las oclusiones y tienden a perder la pista de los objetos que quedan temporalmente ocultos a la vista.

«Algunos de los problemas más difíciles para la inteligencia artificial son los más fáciles para los humanos», afirma Carl Vondrick, profesor asociado de informática y galardonado con el premio del Profesorado Joven del Instituto de Investigación de Toyota. Es como cuando los niños pequeños juegan a esconderse y aprenden que sus padres no desaparecen cuando se tapan la cara. Las computadoras, en cambio, pierden la pista cuando algo queda bloqueado u oculto a la vista y no pueden procesar por dónde ha ido el objeto ni recordar su ubicación.

Para resolver este problema, Vondrick y su equipo enseñaron a las redes neuronales los conceptos físicos básicos que son naturales para adultos y niños. De forma similar a cómo un niño conoce la física, observando cómo se desarrollan los acontecimientos en su entorno, el equipo creó una máquina que ve muchos vídeos para aprender conceptos físicos. La idea clave es entrenar a la computadora para que anticipe el aspecto que tendrá la escena en el futuro. Al entrenar a la máquina para resolver esta tarea a través de muchos ejemplos, ésta crea automáticamente un modelo interno de cómo se mueven físicamente los objetos en entornos típicos. Por ejemplo, cuando una lata de bebida desaparece de la vista dentro del refrigerador, la máquina aprende a recordar que sigue existiendo porque vuelve a aparecer en cuanto se vuelve a abrir la puerta del electrodoméstico.

Finalización dinámica de la escena: con un vídeo monocular como entrada, el marco de trabajo produce una representación 4D que captura todo el contenido de la escena junto con todos los objetos estáticos y dinámicos que contiene a lo largo del tiempo. Crédito: Basile Van Hoorick

«He trabajado antes con imágenes y vídeos, pero conseguir que las redes neuronales funcionen bien con información tridimensional es sorprendentemente complicado», explica Basile Van Hoorick, alumno de doctorado en tercer año, que trabajó con Vondrick para desarrollar el marco de trabajo que permite comprender las oclusiones en el momento en que se producen. A diferencia de los humanos, la comprensión de la tridimensionalidad de nuestro mundo no es algo natural para las máquinas. El segundo salto del proyecto consistía no sólo en convertir en 3D a la perfección los datos de las cámaras, sino también en reconstruir toda la configuración de la escena más allá de lo que se ve.

Este trabajo podría ampliar las capacidades de percepción de los robots domésticos. En cualquier ambiente interior, las cosas quedan ocultas a la vista todo el tiempo. Por eso, los robots deben interpretar su entorno de forma inteligente. La situación de la «lata de bebida dentro del refrigerador» es uno de tantos ejemplos. Aun así, es fácil ver cómo cualquier uso que utilice la visión se beneficiará si los robots pueden recurrir a su memoria y a sus habilidades de razonamiento sobre la permanencia de los objetos para seguir la pista de tanto los objetos como de los humanos mientras se mueven por la casa.

Más allá del supuesto de cuerpo rígido

La mayoría de los robots actuales se programan con una serie de supuestos para que funcionen. Una es el supuesto de cuerpo rígido, que asume que un objeto es sólido y no cambia de forma. Y eso simplifica un montón de cosas. Los especialistas en robótica pueden ignorar por completo la física del objeto con el que interactúa el robot y sólo tienen que pensar en su movimiento.

El Laboratorio de Inteligencia Artificial y Robótica de Columbia (CAIR), dirigido por el profesor de Informática Shuran Song, ha estado investigando el movimiento robótico de una forma diferente. Su investigación se centra en objetos deformables, no rígidos: se pliegan, se doblan y cambian de forma. Al trabajar con objetos deformables, los especialistas en robótica ya no pueden confiar en el supuesto de cuerpo rígido, lo que les obliga a pensar de nuevo en la física.

«En nuestro trabajo, intentamos investigar cómo hacen las cosas los humanos de forma intuitiva», explica Shuran Song, también galardonado con el premio del Profesorado Joven del Instituto de Investigación de Toyota. En lugar de intentar tener en cuenta todos los parámetros posibles, su equipo desarrolló un algoritmo que permite al robot aprender de la práctica, lo que lo hace más generalizable y reduce la necesidad de grandes cantidades de datos de entrenamiento. Obligó al grupo a replantearse cómo se realiza una acción, como por ejemplo golpear un blanco con una cuerda. Normalmente no pensamos en la trayectoria de la cuerda, sino que intentamos golpear primero el objeto y ajustamos nuestros movimientos hasta conseguirlo. «Esta nueva perspectiva era esencial para resolver este difícil problema de robótica», señaló Song.

Su equipo ganó el premio al mejor artículo en la Conferencia de Ciencia y Sistemas Robóticos (RSS 2022) por un algoritmo que crearon, la Política Residual Iterativa (IRP). IRP es un marco de aprendizaje general para tareas repetibles con dinámicas complejas, en el que se entrenó un único modelo utilizando datos de simulación imprecisos. El algoritmo puede aprender de esos datos y acertar en muchos objetivos con cuerdas desconocidas en experimentos robóticos, alcanzando una precisión inferior a los centímetros y demostrando su gran capacidad de generalización.

El robot aprendió a dar en el blanco (un vaso amarillo) en siete intentos. Crédito: Cheng Chi

«Antes, para alcanzar este nivel de precisión, el robot tenía que realizar la tarea entre 100 y 1.000 veces», explica Cheng Chi, estudiante de doctorado en tercer año, que trabajó con Song para desarrollar el PIR. «Con nuestro sistema, podemos hacerlo en diez veces, que es más o menos el mismo rendimiento que una persona».

Los investigadores se dieron cuenta de que el movimiento de lanzamiento de su robot seguía teniendo algunas limitaciones. Aunque es eficaz, está limitado por la velocidad del brazo robótico, lo que significa que no puede manipular objetos grandes. Por no hablar de que es peligroso tener un movimiento rápido cerca de la gente.

El equipo de Song llevó esta investigación un paso más allá, y desarrolló un nuevo método para manipularlas utilizando aire soplado de forma activa. Armaron su robot con una bomba de aire y fue capaz de desplegar rápidamente un gran trozo de tela o abrir una bolsa de plástico. El marco de aprendizaje autosupervisado que denominan DextAIRity aprende a realizar eficazmente una tarea objetivo mediante una secuencia de agarres o soplado. A través de una retroalimentación visual, el sistema utiliza una formulación de bucle cerrado que ajusta continuamente la dirección del aire.

El método basado en aprendizaje de DextAIRity puede abrir de forma rápida y fiable la mayoría de las bolsas probadas. Crédito: Zhenjia Xu

«Una de las estrategias interesantes que desarrolló el sistema para abrir bolsas es dirigir el aire un poco por encima del plástico, para mantener abierto el orificio», explica Zhenjia Xu, alumna de doctorado en cuarto año, que trabaja con Song en el Laboratorio CAIR. «No lo anotamos ni lo entrenamos de ninguna manera; lo aprendió solo».

¿Qué hay que hacer para que los robots sean más útiles en nuestros hogares?

Actualmente, los robots pueden maniobrar con éxito en un entorno estructurado con zonas claramente definidas y, de modo simultáneo, realizar alguna tarea. Sin embargo, un robot doméstico realmente útil debe tener varias habilidades, ser capaz de trabajar en un entorno desestructurado (como un salón con juguetes en el suelo) y manejar diferentes situaciones. Estos robots también tendrán que saber identificar una tarea, qué subtareas deben realizarse y en qué orden. Y luego, tendrán que saber qué hacer a continuación si fracasan en un trabajo y cómo adaptarse a los siguientes pasos necesarios para lograr su objetivo.

«Los avances que Carl Vondrick y Shuran Song han logrado con sus investigaciones contribuyen directamente a la misión del Instituto de Investigación de Toyota», afirma el Dr. Eric Krotkov, asesor del Programa Universitario de Investigación. «La investigación del TRI en robótica (y más allá) se centra en desarrollar las capacidades y herramientas necesarias para afrontar los retos socioeconómicos de una sociedad que envejece, la escasez de mano de obra y la producción sostenible. Dotar a los robots de la capacidad de comprender objetos ocluidos y manejar objetos deformables les permitirá mejorar la calidad de vida de todos».

Song y Vondrick planean colaborar para combinar sus respectivos conocimientos de robótica y visión computarizada para crear robots que ayuden a las personas en el hogar. Al enseñar a las máquinas a entender los objetos cotidianos de los hogares, como la ropa, la comida y las cajas, la tecnología podría permitirles ayudar a las personas con discapacidades motrices y mejorar la calidad de vida diaria de la gente. Al aumentar el número de objetos y conceptos físicos que pueden aprender los robots, el equipo pretende hacer posibles estas aplicaciones en el futuro.

Proporcionado por la Escuela de Ingeniería y Ciencias Aplicadas de la Universidad de Columbia